Der EU AI Act ist da – und die meisten Unternehmen sind nicht vorbereitet. Was jetzt zu tun ist.

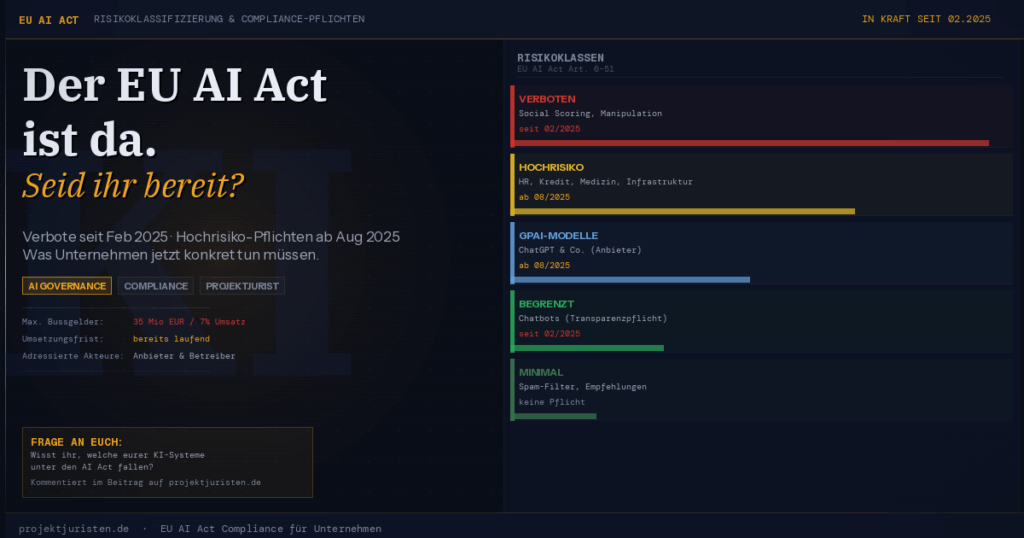

Seit Februar 2025 gilt der EU AI Act in wesentlichen Teilen. Verbote greifen, Pflichten für Hochrisiko-KI laufen an. Wer jetzt noch nicht gehandelt hat, riskiert Bußgelder bis zu 35 Millionen Euro. Dieser Beitrag erklärt, was das konkret bedeutet – und warum Projektjuristen die pragmatischste Antwort auf den Umsetzungsdruck sind.

Die E-Mail kommt von der IT-Abteilung: „Wir wollen ab nächstem Quartal ein KI-System zur automatisierten Vertragsprüfung einsetzen. Brauchen wir dafür irgendwas?“ Der Legal Counsel öffnet den Browser, sucht nach „EU AI Act Pflichten“ und landet auf 144 Seiten Verordnungstext sowie einer Vielzahl widersprüchlicher Blogbeiträge. Zwei Wochen später ist die Frage noch immer offen.

Das Szenario ist kein Einzelfall. Der EU Artificial Intelligence Act – die weltweit erste umfassende KI-Regulierung – ist seit August 2024 in Kraft und entfaltet seine Wirkung schrittweise: Die Verbote für unzulässige KI-Praktiken gelten seit Februar 2025, die Pflichten für Hochrisiko-KI-Systeme ab August 2025. Und trotzdem haben die meisten mittelständischen Unternehmen noch keine strukturierte Antwort auf die Frage: Was müssen wir eigentlich tun?

Dieser Beitrag liefert eine praxisorientierte Einordnung – und zeigt, wie Projektjuristen Unternehmen dabei helfen, vom Zustand „irgendwie betroffen“ in den Zustand „kompliant und zukunftssicher“ zu kommen.

Was der EU AI Act wirklich verlangt – ohne Juristendeutsch

Der AI Act teilt KI-Systeme in Risikoklassen ein. Die Logik ist einleuchtend: Je größer das potenzielle Schadenspotenzial, desto strenger die Anforderungen.

Verbotene KI (seit Februar 2025)

Systeme, die Menschen nach sozialem Verhalten bewerten und benachteiligen („Social Scoring“), die Emotionen am Arbeitsplatz oder in Bildungseinrichtungen überwachen, oder die Verhaltensmanipulation durch unterschwellige Beeinflussung betreiben, sind vollständig verboten. Wer solche Systeme betreibt oder einsetzt, riskiert Bußgelder bis zu 35 Millionen Euro oder 7 Prozent des weltweiten Jahresumsatzes.

Hochrisiko-KI (Pflichten ab August 2025)

Systeme, die in kritischen Bereichen eingesetzt werden – Personalentscheidungen, Kreditvergabe, medizinische Diagnostik, Infrastruktur, Strafverfolgung – gelten als Hochrisiko-KI. Für sie gelten umfangreiche Pflichten: Risikomanagementpäne, technische Dokumentation, Prüfverfahren, Transparenzpflichten gegenüber Nutzern und Behörden sowie laufendes Monitoring. Wer solche Systeme als Anbieter in Verkehr bringt oder als Betreiber einsetzt, ist direkt adressiert.

Allgemeine KI-Systeme (GPAI) und Transparenzpflichten

Für Systeme wie ChatGPT oder vergleichbare Large Language Models gelten eigene Regelungen – insbesondere für Anbieter. Wer solche Systeme in eigene Produkte oder Prozesse integriert, muss sicherstellen, dass die Nutzungsbedingungen der GPAI-Anbieter und die eigenen Compliance-Pflichten übereinstimmen. Auch die Transparenzpflicht – Nutzer müssen wissen, wenn sie mit KI interagieren – gilt bereits.

Drei Fehler, die Unternehmen jetzt machen

1. „Betrifft uns nicht“

Der AI Act gilt nicht nur für Tech-Konzerne oder KI-Entwickler. Er gilt für jeden, der KI-Systeme in der EU betreibt oder einsetzt – unabhängig davon, ob das System selbst in der EU entwickelt wurde. Wer ein KI-basiertes HR-Tool nutzt, automatisierte Entscheidungsunterstützung im Einkauf einsetzt oder Chatbots im Kundenservice betreibt, ist potenziell adressiert.

2. Abwarten bis zur vollständigen Anwendbarkeit

Die Vollabwendbarkeit kommt August 2026 – aber wesentliche Pflichten gelten bereits jetzt. Und die Umsetzung der Hochrisiko-Anforderungen braucht Zeit: Dokumentation aufbauen, Risikobewertungen durchführen, interne Prozesse anpassen. Wer heute beginnt, ist in zwanzig Monaten gut aufgestellt. Wer in zwanzig Monaten anfängt, ist zu spät.

3. Das Thema nur in der IT lösen

KI-Compliance ist kein reines Technologiethema. Es braucht juristische Einordnung (Welche Systeme fallen unter welche Risikoklasse?), Prozessgestaltung (Wie werden Anforderungen operativ verankert?) und Schnittstellen zu Datenschutz, Arbeitsrecht und Vertragsrecht. Ohne juristischen Sachverstand entsteht bestenfalls Dokumentation ohne Substanz.

Was konkret zu tun ist: Die fünf ersten Schritte

KI-Compliance lässt sich strukturiert angehen. Diese fünf Schritte bilden ein bewährtes Grundgerüst:

- KI-Inventar erstellen: Welche KI-Systeme werden im Unternehmen genutzt oder betrieben? Auch eingekaufte oder via API genutzte Dienste zählen.

- Risikoklassifizierung: Für jedes System: Verboten, Hochrisiko oder allgemein? Die Einordnung bestimmt den Handlungsbedarf.

- Sofortmaßnahmen bei Verboten: Werden verbotene Praktiken genutzt? Wenn ja, sofortiger Handlungsbedarf – ohne Aufschub.

- Compliance-Roadmap für Hochrisiko: Technische Dokumentation, Risikomanagementplan und Monitoring-Strukturen aufbauen.

- Verträge mit KI-Anbietern prüfen: Decken bestehende Nutzungsverträge die neuen Compliance-Anforderungen ab? Oft nicht.

Warum Projektjuristen hier besonders gut passen

AI Act-Compliance ist kein Dauerprojekt, das eine neue Vollzeitstelle rechtfertigt – zumindest nicht in den meisten Unternehmen. Es ist ein begrenztes, aber anspruchsvolles Umsetzungsvorhaben mit klarem Zeitrahmen. Genau das ist das natürliche Einsatzfeld eines Projektjuristen.

Ein Projektjurist mit Schwerpunkt Datenschutz, IT-Recht oder Compliance kennt die regulatorische Materie, versteht die operative Unternehmensrealität und kann das KI-Inventar, die Risikoklassifizierung und die Compliance-Roadmap eigenständig entwickeln. Er arbeitet als Teil des Teams – nicht als externer Gutachter, dessen Einschätzung dann intern neu übersetzt werden muss.

Das spart Zeit, Geld und – am wichtigsten – Nerven. Denn die Zeit läuft bereits.